AI speelt een steeds grotere rol in onze economie en samenleving. Om AI veilig en betrouwbaar te gebruiken, werkt het kabinet aan het nationale toezicht op de Europese AI-verordening. Staatssecretaris van Economische Zaken - Digitale Economie en Soevereiniteit Willemijn Aerdts heeft het voorstel voor de uitvoeringswet AI-verordening op maandag 20 april 2026 in internetconsultatie gebracht.

Aerdts: “AI biedt enorme kansen voor onze economie, innovatie en onze dagelijkse levens. Maar die kansen kunnen we alleen benutten als mensen erop kunnen vertrouwen dat AI veilig en verantwoord wordt gebruikt. Met een sterk AI-toezichtstelsel zorgen we voor duidelijke regels en houden we tegelijk ruimte voor innovatie en ondernemerschap.”

Toezicht grotendeels nationaal geregeld

De Europese AI-verordening (AI Act) stelt in de hele Europese Unie regels voor de ontwikkeling en toepassing van AI-systemen en -producten. Maar het toezicht op de naleving van deze regels moet grotendeels nationaal worden geregeld. De uitvoeringswet AI-verordening maakt dat toezicht mogelijk.

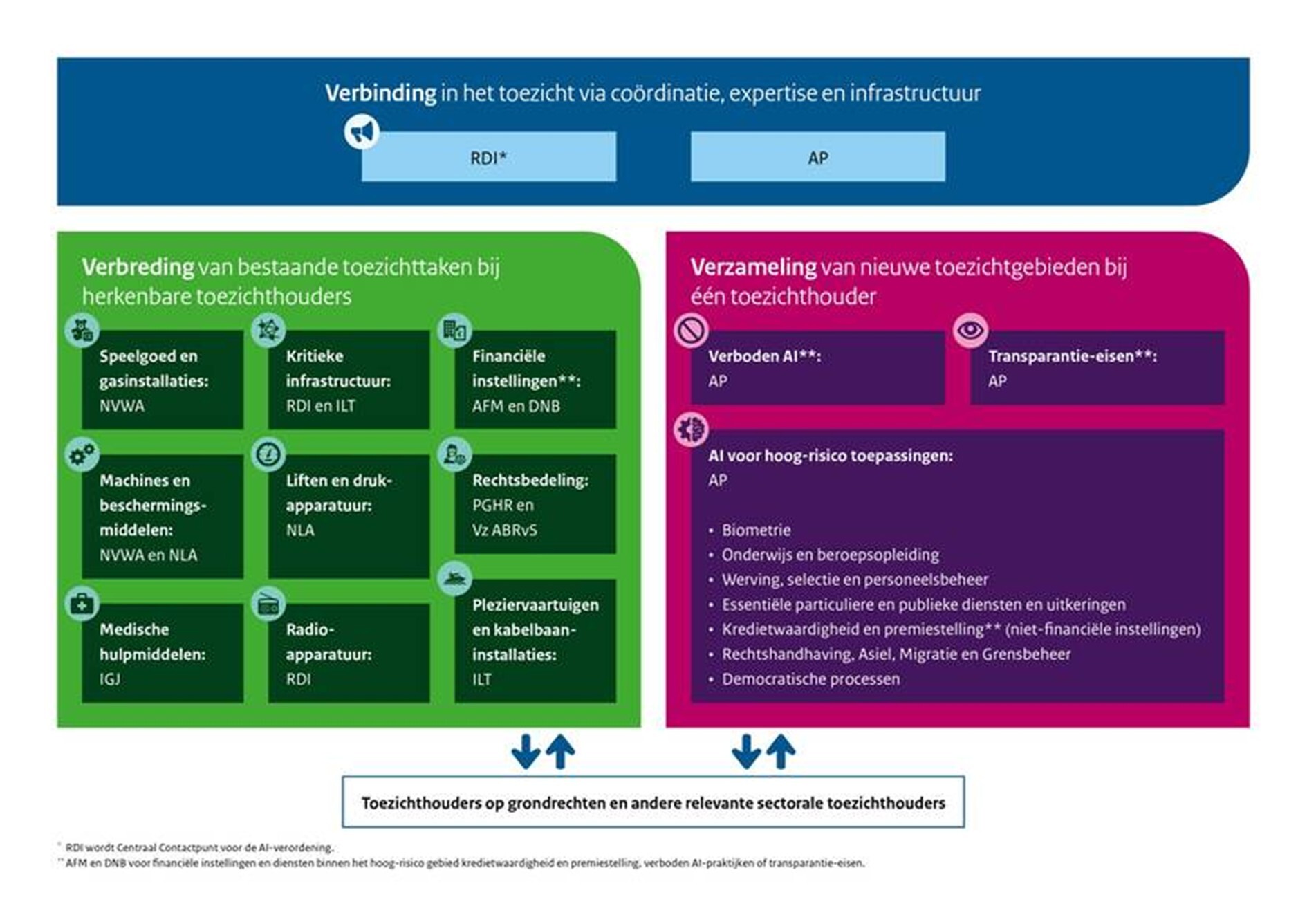

Omdat AI in veel sectoren wordt toegepast, stelt het kabinet een toezichtstructuur voor waarin meerdere bestaande toezichthouders samenwerken (zie figuur hieronder) . In het voorstel houden de toezichthouders binnen hun eigen domein toezicht op AI. Hierdoor krijgen ondernemers en organisaties zoveel mogelijk te maken met instanties die zij nu ook al kennen. Voor toezichtgebieden waar nog geen duidelijke toezichthouder bestaat, wordt de Autoriteit Persoonsgegevens (AP) voorgesteld als de toezichthouder met een speciale AI-bestuurder. De AP en de Rijksinspectie Digitale Infrastructuur (RDI) krijgen een coördinerende rol binnen dit voorgenomen toezichtstelsel.

Lees ook:

Figuur 1: De voorgenomen toezichtstructuur van de AI Verordening

Lees de brief aan de Tweede Kamer over de inrichting van het toezicht

Risicogebaseerde regels voor AI

De Europese AI-verordening stelt eisen aan AI-systemen op basis van het risico dat ze hebben voor onze veiligheid, gezondheid of grondrechten. Sommige toepassingen zijn verboden, zoals manipulatieve AI-praktijken of het massaal verzamelen van gezichtsbeelden voor biometrische databases. Aan zogenoemde hoog-risico AI-systemen worden verschillende eisen gesteld aan de ontwikkeling en het gebruik, bijvoorbeeld op het gebied van datakwaliteit, risicobeheer, menselijk toezicht en transparantie. Ook moet duidelijk gemaakt worden wanneer mensen rechtstreeks met AI-systemen communiceren, bijvoorbeeld via chatbots of AI-gegenereerde content.

Consultatie

De verordening is al gedeeltelijk van toepassing en de resterende onderdelen worden in augustus 2026 respectievelijk augustus 2027 van toepassing. Het wetsvoorstel is tot en met 1 juni 2026 (online) opengesteld voor consultatie.

Ga naar de internetconsultatie

Reactie Digital Holland

AI en Data vormen samen met negen andere sleuteltechnologieën de strategische ruggengraat van het Nederlandse technologie- en innovatiebeleid. Onder regie van Digital Holland is de Actieagenda AI/Data - die voortvloeit uit de Nationale Technologie Strategie (NTS) - ontwikkeld. ‘Recente en komende wet- en regelgeving biedt kansen voor ethische AI en datatoepassingen, maar is ook veel en complex’, staat in de Actieagenda. Daarnaast is de samenhang tussen de vele beleidsinitiatieven nu vaak niet helder. Frits Grotenhuis, directeur van Digital Holland ziet dit als belangrijke stap van het kabinet voor nationaal toezicht op de Europese AI-verordening. “De Nederlandse vertaling van de AI Act biedt handvaten, kaders en richting voor organisaties om AI-systemen verantwoord te ontwikkelen en toe te passen, in lijn met Europese wetgeving en met oog voor transparantie, veiligheid en ethiek.”